论文链接:https://arxiv.org/pdf/2504.02546

代码链接:https://github.com/AMAP-ML/GPG

摘要

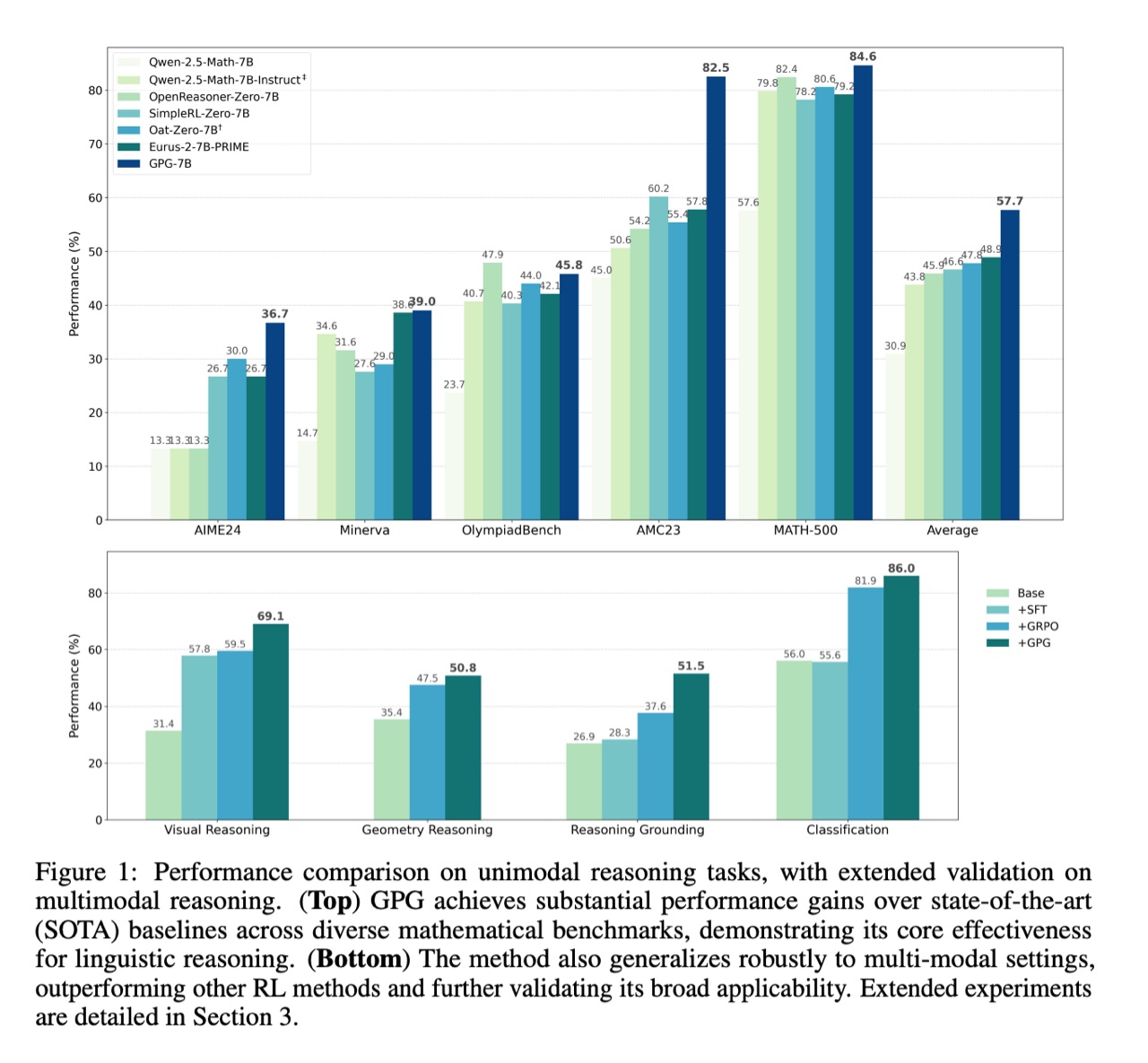

强化学习 (RL) 可以直接增强大语言模型的推理能力,而无需过度依赖有监督微调 (SFT)。在本研究中,我们重新审视了传统的策略梯度 (PG) 机制,并提出了一种极简的强化学习方法,称为组策略梯度 (GPG)。与传统方法不同,GPG 直接优化原始强化学习目标,从而消除了对替代损失函数的需求。通过消除 critic 模型和 reference 模型、避免 KL 散度约束以及解决优势模型和梯度估计偏差,我们的方法与组相对策略优化 (GRPO) 相比显著简化了训练过程。我们的方法无需依赖辅助技术或调整即可实现卓越的性能。如图 1 所示,大量实验表明,我们的方法不仅降低了计算成本,而且在各种单模态和多模态任务中始终优于 GRPO。我们的代码可在 https://github.com/AMAP-ML/GPG 获取。

1.介绍

大语言模型 (LLM) 取得了长足的进步,逐步缩小了与通用人工智能 (AGI) 的差距。近期,以 OpenAI o1 和 DeepSeek R1 为代表的 LLM 采用了在生成最终答案之前生成中间推理步骤的策略。这种方法显著提升了它们在数学推理等特定领域任务中的效率。这项技术的显著成功主要归功于强化微调 (RFT) 方法。通过应用 RFT,模型在生成答案之前分配了额外的时间进行“深思熟虑”,从而构建了复杂的推理链,并最终提升了模型的整体性能。

与有监督微调 (SFT) 涉及在固定的输入输出对上训练模型以模拟正确响应不同,RFT 引入了一个迭代过程,激励模型生成连贯且逻辑结构化的推理路径。RFT 利用强化学习 (RL) 技术,例如近端策略优化 (PPO) 和 GRPO,在生成中间步骤的过程中优化决策。具体而言,PPO 通过限制策略更新来确保稳定性,防止新策略与既定行为发生显著偏差。相比之下,GRPO 通过评估不同动作组的性能来增强这一过程,鼓励推理质量的持续改进。这种动态且反馈驱动的方法使模型能够进行更深入、更具适应性的思考,从而产生细致入微的答案,与 SFT 更为僵化且依赖标签的训练相比,能够更好地处理复杂的推理任务。

尽管 PPO 在提升推理质量方面取得了显著成功,但它仍然严重受限于训练过程中所需的巨大资源消耗。PPO 需要开发和集成 critic 模型和 reference 模型,这不仅增加了训练过程的复杂性,也显著增加了计算需求。因此,简化 PPO 方法的趋势日益明显。例如,ReMax 通过引入 base 值来移除 critic 模型,从而降低了训练 GPU 内存占用并加速了训练过程。此外,GRPO 消除了对 critic 模型的需求,并在样本组内使用归一化奖赏。

除了这些提高效率和稳定性的方法外,近期同时开展的一项研究 Dr.GRPO 也研究了奖赏和损失正则化的细节,并指出 GRPO 倾向于生成更多 token。然而,尽管它揭示了优势函数中的奖赏偏差,但我们观察到其性能并未显著优于 GRPO。

深入研究强化学习 (RL) 社区的演变历程,我们发现,广为采用的 PPO 算法本质上只是原始 RL 问题的保守替代。所有现有的 PPO 增强算法都仍然专注于优化替代损失函数。因此,两个基本问题仍未得到解决:

- 超越这种中间策略并直接优化原始问题是否可行?

- 如果可以实现,学习策略可以在多大程度上得到简化?

本文致力于对这些关键问题进行全面的探讨。总而言之,我们的主要贡献如下:

- 我们重新审视了策略梯度算法的设计,并提出了一种简单的强化学习方法,该方法保留了最少的强化学习组件。与传统方法不同,我们的方法直接优化目标函数,而不是依赖于替代损失。

- 我们的方法避免了对 critic 模型和 reference 模型的依赖。此外,它不施加任何分布约束。这些特性为潜在的可扩展性带来了巨大的优势。

- 我们分析并论证了现有优势函数中固有的奖赏偏差,并揭示了简单去偏差方法的局限性。我们对梯度估计偏差现象的探索促使我们提出了一种简单而准确的梯度估计 (AGE) 技术。为了缓解有效样本比例过小时梯度估计方差过大的潜在问题,我们引入了一种简单的阈值机制,以确保有效样本的最小划分,然后再进行重采样。

- 大量实验表明,GPG 在各种单模和多模视觉任务中取得了 SOTA 结果。

我们的代码和实现细节都是开源的。

2.方法

2.1 Preliminary and Task Formulation

强化学习是一种通过交互进行学习的计算方法,其中 Agent 通过在环境中选择最优动作来寻求最大化累积奖赏。强化学习问题通常由策略 定义,该策略将状态映射到动作,旨在优化期望回报。策略梯度方法的核心思想是利用梯度上升来迭代调整策略参数。学习目标是最大化回报 ,

策略梯度定理证明上述问题可以转化为估计梯度,

其中 是动作价值函数,表示在状态 下采取行动 并随后遵循策略 时的期望回报。

为了减少方差,通常使用优势函数 ,从而得到策略梯度更新规则:

One-step advantage estimation 可以用数学公式表示为:

其中 是 的函数。原则上, 可以采用任何函数形式。一个常用的函数是价值函数,它表示从状态 开始并遵循策略 时的期望回报。虽然 GAE 提供了一种更复杂的方法来平衡优势估计中的偏差和方差,但我们发现,在模型推理的背景下,One-step advantage estimation 足以获得良好的性能。这种简单性在计算效率至关重要的场景中尤其有利。

给定一系列问题和指令,模型的任务是生成相应的答案。随后,系统会根据预定义的奖赏模型或手动制定的规则返回奖赏。我们的目标是利用这些奖赏信号来优化策略,从而增强模型生成准确且符合语境的响应的能力。

然而,设计或获取中间步骤的准确奖赏并非易事。为了应对这一挑战,我们将问题简化如下。给定一个问题和提示 ,我们从策略 中采样一个动作 ,并获得最终的奖赏信号 。注意,策略分布 是以自回归方式建模的。在这种情况下,我们可以利用策略梯度方法来优化策略。

2.2 Group Policy Gradient

我们提出的方法 —— Group Policy Gradient (GPG),旨在解决在缺乏 value 模型的情况下策略梯度估计方差过大的问题。通过利用组级奖赏,GPG 可以稳定学习并增强强化学习训练的鲁棒性。具体而言,GPG 利用每个组内的平均奖赏来归一化奖赏,从而有效地降低方差。这种方法无需传统的价值模型,从而简化了训练过程并提高了计算效率。“组策略梯度”这一名称反映了我们方法的核心机制,即利用组级平均奖赏来稳定和优化学习。

GPG的核心目标定义为:

其中 表示组 G 中的单个响应,第 个响应的优势通过对组级奖赏 进行归一化来计算:

是一种可选的归一化技术,通常与奖赏裁剪结合使用,以减轻意外异常值的影响。一种广泛采用的做法是在训练 batch 内采用标准方差归一化。这种方法通过降低奖赏信号的方差来帮助稳定训练过程,这在处理奖励幅度可能存在显著差异的环境(例如不同的 Atari 游戏)时尤为重要。通过对奖赏信号进行归一化,模型对极值的敏感度会降低,从而提高训练算法的鲁棒性和收敛性。然而,在涉及大型模型的推理任务中,奖赏通常定义明确,不会受到其他环境中观察到的方差问题的影响。对于数学推理问题,通常的做法是给正确答案 1.0 分,给错误答案 0.0 分。

我们利用 open-r1 中 SimpleRL 的基础数学推理设置,仅使用 MATHlighteval 数据集来快速进行实验验证。具体来说,为了简化操作,我们移除了格式奖赏,只启用了准确率奖励。

关键组成部分:,在先前的推理研究中尚未得到充分探索。这一文献空白凸显了进一步研究 在推理任务中的作用和影响的必要性。目前有两个问题尚未解决。

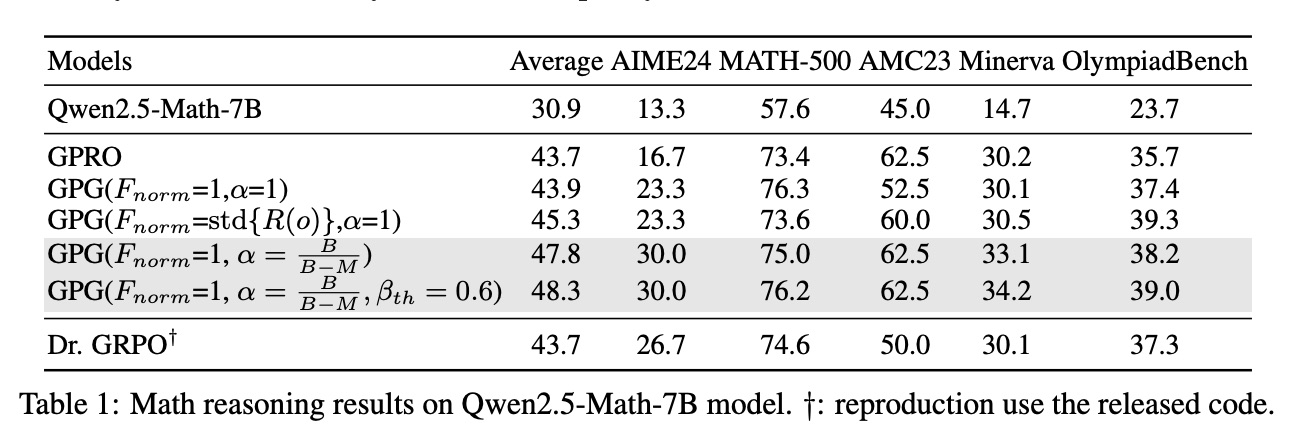

不应引入奖赏偏差。否则,偏差会偏离原始问题公式。GRPO 将其公式化为 ,它本质上是公式 2 中 的函数,并明确引入了奖赏偏差。由于我们的目标是解决原始问题,因此我们不想应用替代变量或偏差。然而,如表 1 所示,如果我们移除这个偏差项,即 ,它(43.9%)的表现并不能明显优于 GRPO(43.7%),这与 Dr. GRPO 同期研究的结果相反。

同一组中全部正确或全部错误响应的样例会为梯度估计引入偏差。给定一个 batch size 为 的训练样例,令第 个样本的梯度表示为 。不失一般性,假设该 batch 中的前 个样例均为同一组中的正确或错误响应。标准反向传播 (BP) 算法将梯度估计为:。然而,前 个示例对于梯度估计无效,贡献的梯度为零。因此,更准确的梯度估计 (AGE) 可以写成:

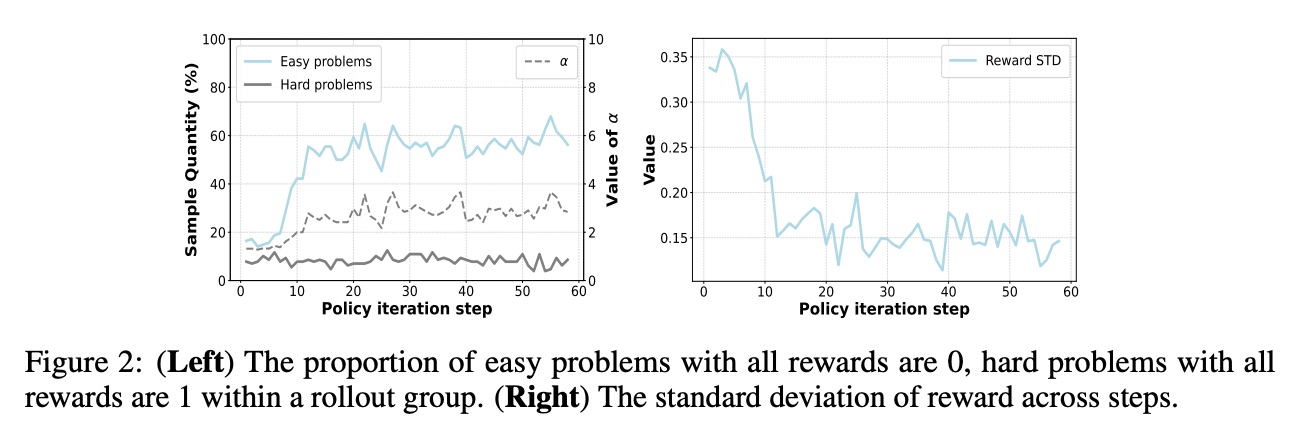

需要注意的是, 值不是常数,它会随着不同的 batch 而变化。我们还在图 2 中用不同的步长说明了 ,这表明了梯度校正的必要性。对于多 GPU 训练,为了实现更精确的梯度计算,建议收集所有 GPU 上的所有非零梯度样本,并统一计算平均梯度。这种方法可以通过自定义梯度聚合函数来实现,但这会增加通信开销。为此,我们推导出另一种等效格式,它不需要额外的开销,并在 A 部分提供证明。因此,给定一个batch样本,目标可以写成:

在一个场景中,我们舍弃 M 个样本,并以类似于近期研究中所提出的方法对响应进行重新采样,直到 M 等于 0,此时 α 被设置为 1。然而,这种特定的设置训练效率不高。原因是训练时间受限于花费最长时间收集所需样本的人工。相比之下,我们提出的方法表现出了更高的效率。此外,它能够根据样本批次的表现自动调整损失。

我们还评估了 GRPO 的奖赏正则化设置,其中 ,并将结果列于表 1。它比 Fnorm=1,α=1 的平均得分高出 1.4%。这促使我们深入探究改进的来源。我们在图 2 中绘制了奖励的标准差 (std)。注意,std 是通过对每组的标准差取平均值计算得出的,其值范围为 0.10 到 0.35。α 的范围为 1.5 到 4.0。GRPO 的奖赏正则化提供了这样一种(在组内)标准差机制,它具有一定的梯度校正效果。

对有效样本进行最小分割阈值化并重采样以降低方差。虽然我们的方法能够对梯度进行无偏估计,但当有效样本比例过低时,可能会出现方差过大的问题。为了解决这个问题,我们引入了一个阈值 来控制有效样本的比例。当该比例低于给定值时,我们将有效样本累积到重采样后的后续批次中,直到比例超过阈值。该策略有效地降低了梯度估计的方差,从而提高了模型训练过程的稳定性和收敛速度。值得一提的是,该策略可以进一步提升性能,如表 1 所示。

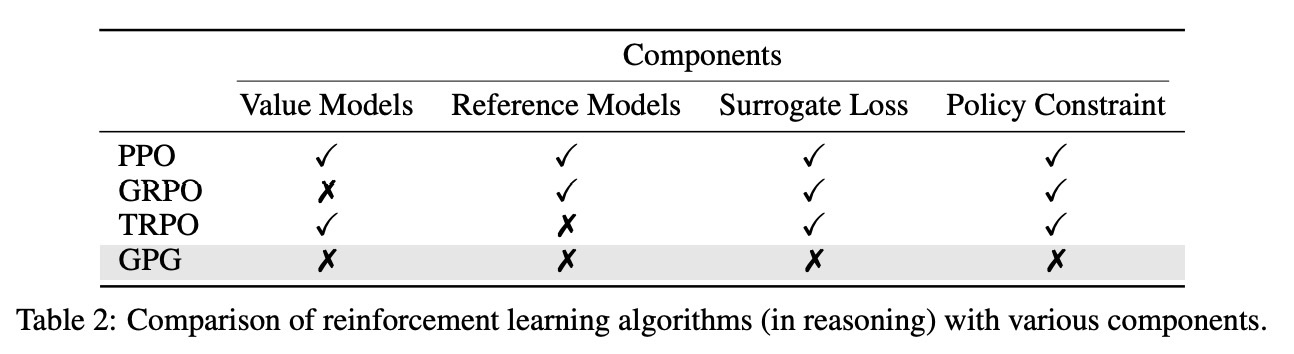

强化学习算法在处理方差和优化策略的方法上差异很大。许多强化学习算法的两个关键组成部分是替代损失和策略约束。我们在表 2 中总结了各种框架的主要比较结果。我们的方法因保留了最简单的形式而脱颖而出,这不仅确保了易于实现,而且还保持了较高的效率和有效性。